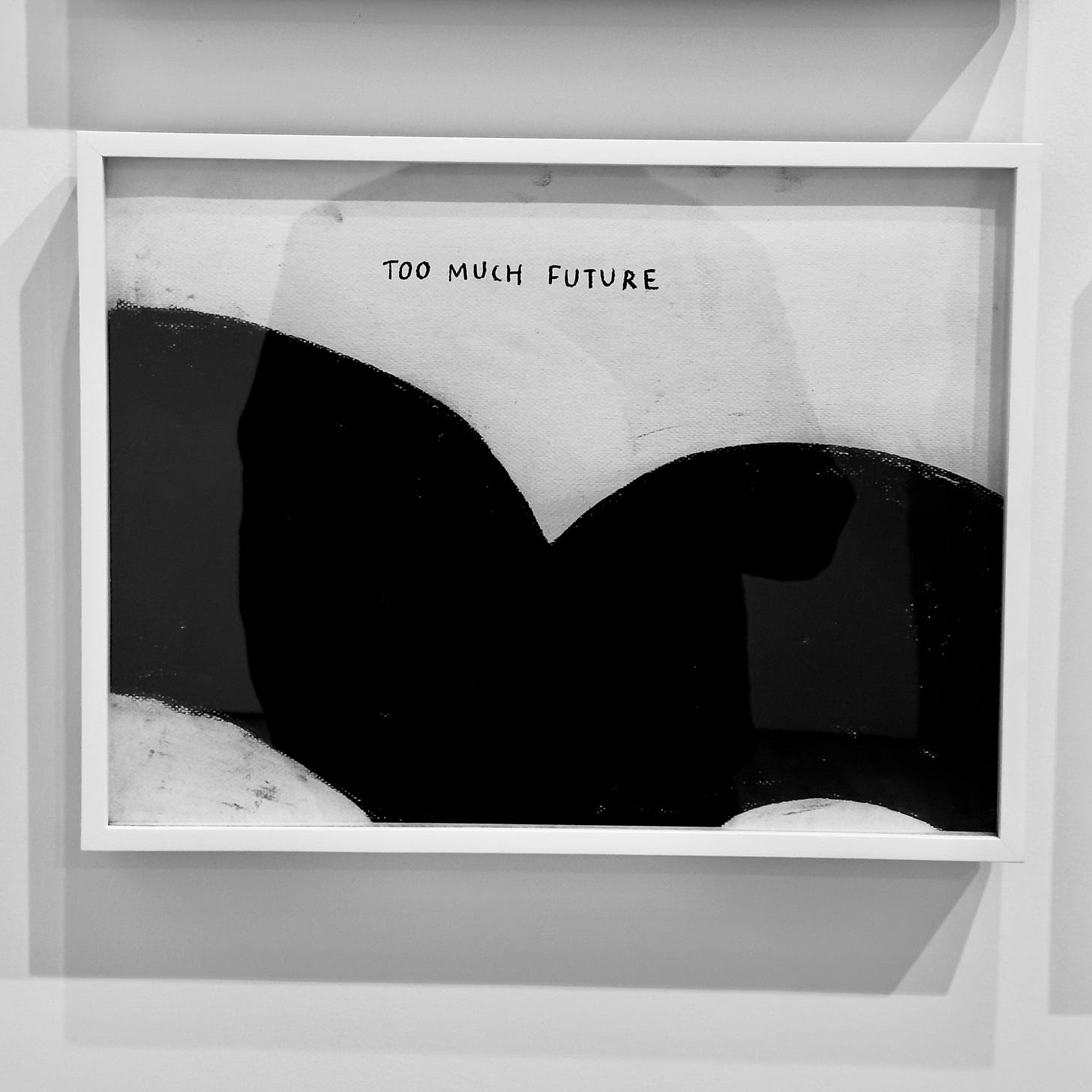

Don't let the AI in...

Quando nos damos conta que a decisão ainda é (e sempre será) nossa

Recentemente tive o privilégio de participar de uma conferência na Universidade de Yale chamada “AI and the Ends of Humanity”1.. Em um dos momentos dessa conferência foi citado o artigo de James Moor, “Are There Decisions Computer Should Never Make?” (1979). Neste trabalho, ele traz uma linha (bem tênue, inclusive) que tenta demarcar o território entre o tipo de decisão que podemos delegar a um computador e o tipo que não devemos. Para ele, decisões últimas (relacionadas a valores e objetivos finais) não devem ser delegadas, porque valores são criações essencialmente humanas, e devem ter seres humanos como responsáveis pelas decisões que os envolvem2.

Uma das questões que mais me fascina no mundo do trabalho (e do trabalho em tecnologia principalmente) são as implicações sociais do que fazemos. Sempre fico curioso ao pensar no impacto que um simples deploy de uma nova funcionalidade pode ter. Podemos ir do céu ao inferno, criar mundos e destruir economias por conta de tomadas de decisão realizadas em ambientes que nós, pessoas de produto, estamos inseridas. A despeito da pretensão dessa frase, estamos no centro de decisões que moldam realidades.

No meio de todo o hype de AI eu tenho pensado sobre como o uso dessas tecnologias tem afetado a qualidade do nosso trabalho. Que tipo de ser humano eu tenho me tornado? Que tipo de seres humanos têm sido formados através das coisas que eu faço? E, acima de tudo: que sociedade estamos incentivando?

Temos visto ferramentas cada vez mais capazes e poderosas, e isso deve crescer ainda mais. Com poucas palavras podemos criar aplicativos do zero, conectar com automações, bancos de dados, infraestruturas… Vibe-coding, product builders, palavras mágicas escritas em um chat e, segundos depois, (às vezes minutos) o trabalho de uma semana é cuspido na tela.

Mais importante do que como você criou, a questão última sobre o porquê você criou é a que realmente tem valor. E mesmo que uma AI tente te ajudar a responder isso, ela não vai chegar às questões últimas. Não faz parte da competência dela, e seria tolice acreditar no contrário. Como disse Noah Chomsky3, o perigo é que “nós podemos confundir o output desses programas com uma verdadeira compreensão humana”. Para evitar isso, temos que ter bem estabelecido que a AI “não é, e não pode ser [acrescentaria aqui - de forma nenhuma], inteligente no sentido humano”

Entretanto, o dilema entre delegar algo e assumir a responsabilidade sobre isso ainda existe. Pedir para uma ferramenta fazer o seu trabalho não torna essa ferramenta responsável por ele. Por mais que a gente corte caminho e se torne mais eficiente em certas tarefas, no fim do dia trabalho continua dando trabalho porque ser humano é algo custoso: envolve uma decisão existencial de ser alguém, de tomar uma decisão, de decidir entre A ou B, de ter a Coragem de Ser4 no meio de toda ansiedade da dúvida que a modernidade nos trouxe. Decidir pela nossa humanidade é um dos imperativos mais necessários para o momento atual.

Antes que você pense que meu tom aqui é crítico a AI e que tudo o que nos resta é desligar nossos computadores, meu interesse está mais na zona cinzenta na qual estamos inseridos. Nunca foi sobre computadores ou tecnologias da moda.

Mas, por outro lado, o contexto que temos é este. Novos paradigmas científicos estão postos, a AI faz e fará cada vez mais parte da nossa vida. Por isso, meu convite é para refletirmos sobre o florescimento de um tipo de existência humana que considera a sua própria singularidade e responsabilidade. No fim, a decisão de tomar a decisão ainda é sua. Don't let the AI in5…

“AI and the Ends of Humanity”, Yale Divinity School.

Desde que li o texto do Moore, vi várias reações e achei que o trabalho da Deborah G. Johsnon revisita alguns termos e provoca algumas conclusões do Moore. Para ela, valores últimos não são tão últimos assim (e percebi que esse uso do termo último foi uma licença poética minha na tradução). De qualquer forma, valores não são abstratos - eles são contestáveis, situados em um contexto específico e muitas vezes usados a favor de certas causas. Dessa forma, não existe nada neutro - nem em uma tecnologia como AI muito menos na ação humana.

Noah Chomsky em The False Promise of ChatGPT.

Paul Tillich (1886–1965) foi um teólogo e filósofo existencialista conhecido por conectar a teologia cristã ao pensamento existencial moderno. Em A Coragem de Ser (1952), ele explora como os indivíduos enfrentam a ansiedade existencial, especialmente o medo da falta de sentido. Ele argumenta que a verdadeira coragem não vem da negação desse medo, mas da afirmação da própria existência por meio de uma conexão profunda com o “ser em si” (being-itself).

Pensei no título desse texto enquanto ouvia Killer Mike, que não tem muito a ver com o que escrevi, mas fica aí a dica: